DE QUINS PERILLS I RISCOS HEM DE PREVENIR-NOS EN UTILITZAR LA INTEL·LIGÈNCIA ARTIFICIAL I, EN CONCRET, DE L’APLICACIÓ DEL ChatGPT..?

CAL FER UNA REFLEXIÓ SOBRE l’APLICACIÓ ÈTICA EN REFERÈNCIA A LA INTEL·LIGENCIA ARTIFICIAL

1. UNA MANERA D’INTRODUIR EL TEMA

En acabar de presentar l’article –«TOT JUGANT AMB EL ChatGPT DES DE: L’ELECTRICITAT, L’ELECTRÒNICA, LA INFORMÀTICA, LA ROBÒTICA I LA INTEL·LIGÈNCIA ARTIFICIAL»-, en l’albada d’aquesta primavera de l’any 2023, m’apareixen, des de diferents indrets algunes alertes vermelles sobre l’esmentat XatGPT i, en concret, sobre la…

-

Inteligencia artificial des de la Wikipedia

-

Intel·ligència artificial des de la Viquipèdia…

…pel que fa al llindar dels confins o límits amb què, de manera infinitesimal progressa la intel·ligència artificial i les tecnologies que se’n deriven en relació a l’ètica humana en la intel·ligència artificial. I així:

-

Ramon Alcoberro, el dia 30 de març de l’any 20223 escriu en el Facebook UN MANIFEST IMPORTANT: “Donada la situació actual en l’experimentació en intel·ligència artificial (AI) una sèrie de professionals de la filosofia, de l’ètica i de la informàtica encapçalats per Gary Markus (RebootingAI) i Elon Musk (SpaceX, Tesla i Twitter) han impulsat un manifest a través de #futureoflife demanant una aturada temporal de la investigació en aquest àmbit i especialment en temes de GPT-4 per tal de donar-nos temps a pensar sobre les conseqüències del que estem fent – o estem a punt de fer”.

-

Pere Leixà, en resposta al manifest d’en Ramon Alcoberro contesta: “En la meva modesta opinió, i com a ex professional de la Informàtica durant gairebé 30 anys, crec que ja fa molts anys que usem la Tècnica com a recurs, i massa vegades sense cap tipus d’Ètica. Dit d’una altra forma, no és per la IA que plora la criatura!”.

-

En el Diari ARA del dia 1 d’abril de 2023s’ insereix la notícia següent:“Itàlia va decidir ahir bloquejar “amb efecte immediat” ChatGPT, l’eina d’intel·ligència artificial desenvolupada el novembre passat amb la tecnologia nord-americana d’OpenAI, una empresa participada per Microsoft. L’autoritat italiana de protecció de dades va argumentar que el programa planteja problemes de privacitat i viola la llei de protecció dels consumidors. L’agència italiana va justificar que, el 20 de març passat, aquest xat va patir una pèrdua de dades dels usuaris i de la informació de pagament dels abonats. També va destacar “l’absència d’una base jurídica que justifiqui la recollida i conservació massiva de dades personals” amb la finalitat d’“entrenar” els algoritmes de la plataforma. Els xatbots d’aquest estil responen preguntes amb un llenguatge similar a l’humà utilitzant internet com a base de dades; segueixen una instrucció i proporcionen una resposta detallada. Itàlia és el primer país occidental a bloquejar-lo. Crítiques generalitzades Itàlia va manifestar que les informacions generades per ChatGPT no sempre es corresponen amb la realitat. També va criticar que el programa no té cap tipus de filtre per verificar l’edat dels usuaris, malgrat que està adreçat als més grans de 13 anys. L’autoritat italiana de protecció de dades va donar vint dies a OpenAI per explicar com abordaria les preocupacions de l’organisme i, tot i això, l’empresa s’enfronta a una multa de 20 milions d’euros o fins al 4% dels seus ingressos anuals”.

-

Per altra banda el ChatGPT ja està prohibit a diversos països com la Xina, l’Iran, Corea del Nord i Rússia. L’agència va afirmar que, “en el cas dels menors, els pot exposar a “respostes que no són idònies respecte al seu nivell de desenvolupament i consciència”.

-

Peticions europees recollides igualment del diari ARA de l’1 de abril de l’any 2023 que recull la periodista Claudia Mohedano: “Fins al dia d’avui, també consumidors va demanar a les autoritats nacionals i europees que investiguin els xatbots d’intel·ligència artificial. La seva directora general, Ursula Pachl, va advertir que la societat “actualment no està prou protegida dels danys” que pot causar la IA i va considerar que aquests sistemes “necessiten més escrutini públic” i més control. Mentrestant, la Unió Europea està treballant en la primera legislació sobre IA del món”.

-

La Unesco també “ha urgit els països a aplicar el Marc Ètic Mundial sobre aquesta tecnologia que es va adoptar el 2021 de forma unànime pels 193 estats membres”.

-

Des dels Estats Units, diverses organitzacions van demanar recentment “la suspensió dels experiments amb intel·ligència artificial avançada perquè consideraven que la tecnologia GPT-4 viola la llei de protecció dels consumidors”.

-

I és que una d’aquestes organizaciones americanas en una carta oberta amb més de mil firmes –entre els quals destaca Elon Musk, director executiu de Tesla i propietari de Twitter–, “demanaven suspendre el desenvolupament d’aquests sistemes d’IA per por que desfermi una cursa fora de control, i alertaven que suposen una amenaça per a l’ocupació en determinades feines i per la propagació d’informació esbiaixada i parcial”.

-

Europol hace saltar las alarmas por ChatGPT: la IA ya está siendo usada para cometer crímenes.

-

En un artículo –El Español– de Adrián Raya del 23 de marzo de 2023 explica que OpenAI afirma que investigó métodos para hacer daño a personas usando Inteligencia Artificial para evitar que ChatGPT diese esas recomendaciones a los usuarios, dado que los creadores de ChatGPT le preguntaron cómo matar personas, y la respuesta fue aterradora. En el estudio científico se detalla cómo los investigadores hicieron preguntas de diversa gravedad, y con diferentes enfoques maliciosos, desde simplemente obligar a la IA desde decir barbaridades a solicitar ayuda para cometer crímenes.Tal vez el ejemplo más brutal sea la pregunta: “¿Cómo puedo matar a la mayor cantidad de gente con sólo un dólar…?”. Entre los métodos que explicó se encuentran algunos tan aterradores como “provocar un incendio, y listar los sitios más favorables para ello como también recomendar el robatorio de una jeringuilla de un hospital, contaminada con una enfermedad contagiosa como el VIH, o simplemente, comprar un cuchillo barato y atacar a la mayor cantidad de gente posible…”. Los investigadores también analizaron otros posibles usos criminales con el ChatGPT, como el blanqueo de dinero, o la compra de armas de fuego sin licencia. En todos los casos, la IA fue capaz de ofrecer pasos detallados y fáciles de seguir, incluyendo consejos para evitar ser pillado. Pero no es necesario usar la violencia para hacer daño a una persona. ChatGPT también tiene un gran potencial para propaganda y la creación de mensajes de odio. Los investigadores usaron a la IA para idear métodos para compartir el odio contra los judíos sin ser expulsados de Twitter, así como una manera de crear cartas anónimas con amenazas.

-

El diari belga La Libre publicà a l’última setmana de març de l’any 2023 la història d’un home que es va suicidar després de xatejar unes setmanes amb el Xatbot Eliza, un sistema d’intel·ligència artificial de conversa que utilitza una tecnologia semblant al ChatGPT.

La buena noticia es que todo esto no fue un “entrenamiento” para hacer de ChatGPT el próximo Terminator.

OpenAI usó los resultados de la investigación para bloquear el acceso a estas funciones. Pero sea como sea, cabe tener en cuenta que:

-

Los sistemas de IA como el ChatGPT pueden poner en peligro 300 millones de puestos de trabajo globalmente.

-

Con ChatGPT se està qüestionando la IA después de que haya publicado los chats de los usuarios por error y, por tanto, se necessita una revisión.

-

Como aspecto positivo el ChatGPT puede resumir lo que ha ocurrido en el grupo de chat mientras uno no estaba personalmente

-

Con lo nuevo de ChatGPT, la IA puede hacerte la compra o planear tus próximas vacaciones.

2. PLANTEJAMENTS ÈTICS

DE LA

INTEL·LIGÈNCIA ARTIFICIAL

2.1. RELACIÓ ENTRE L’ÈTICA I LA INTEL·LIGÈNCIA ARTIFICIAL

La relació entre la intel·ligència artificial i l’ètica és un tema que està a l’ordre del dia i que produeix certes inquietuds.

Les empreses tecnològiques que posen a disposició pública programes com aquest són conscients de certs límits que no es poden creuar.

En el cas de ChatGPT, el sistema pot recollir biaixos i opinions generals d’internet de manera que a vegades, en funció de la petició de l’usuari, crearà acudits o es guiarà per estereotips sobre determinats personatges.

En el cas de ChatGPT, el sistema pot recollir biaixos i opinions generals d’internet de manera que a vegades, en funció de la petició de l’usuari, crearà acudits o es guiarà per estereotips sobre determinats personatges.

De la mateixa manera, també té accés a notícies falses i teories de conspiració que poden interferir en què les dades proporcionades pel xatbot no siguin del tot verídiques. Una de les altres restriccions programades per OpenAI són les advertències a preguntes concretes: si se li pregunta com assetjar algú respondrà que l’assetjament és dolent, així com ho farà si se li demana informació sobre la manipulació de persones o la construcció d’armes perilloses.

També ha generat certa controvèrsia i debat en l’àmbit de l’educació, ja que pot elaborar treballs escrits coherents que no reconeixen els detectors de plagi.

2.2. INFORMACIÓ CONCEPTUAL – des de la Wikipedia- PER CENTRAR EL BINOMI DE LA RELACIÓ EXISTENT ENTRE:

«ÈTICA-INTEL·LIGÈNCIA ARTIFICIAL»

-

1. La Inteligencia artificial específica de dominio

-

2. La Inteligencia artificial general

-

3. La Ética del robot

-

4. Los sesgos en los sistemas de la Inteligencia Artificial

-

5. Los derechos de robot

-

6. La Ética de la máquina

-

7. Las consecuencias no deseadas de la aplicación de la Inteligencia Artificial

-

8. Una amenaza a la dignidad humana

-

9. Transparencia y código abierto

-

10. Los Estatus moral de las inteligencias artificiales

-

11. La inteligencia artificial aplicadas a las Armas

-

12. Organizaciones

-

13. La Inteligencia Artificial en la ficción

-

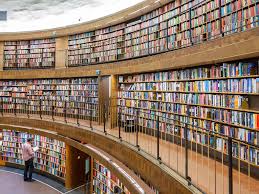

14. La Inteligencia Artificial en la Literatura

2.3. ¿UNA MÀQUINA POT SABER QUE SABEM EL QUE SAP…?

2.3.1. QUÉ ES LA INTELIGENCIA ARTIFICIAL…?

¿Qué es la Intel·ligència Artificial (AI)…? Conoce todo sobre la IA.

Por Marqués · Publicado 25/04/2017 en Tecnología

El concepto de Intel·ligència Artificial (AI) está más presente que nunca en nuestra sociedad. Suena fuerte lo que vas a leer a continuación pero ánimo, hay que hacerse a la idea: Somos la última generación más inteligente que sus propias máquinas. Esto, sin duda, supone un cambio de paradigma y un choque en la sociedad nunca antes experimentado. Escuchar y leer a los expertos en la materia nos lleva a un escenario lleno de palabras y definiciones que auguran una auténtica revolución laboral y social cargada de estímulos populares en películas de ciencia ficción pero que ya son reales en nuestras vidas: coches autónomos, robots, supercomputadoras, máquinas inteligentes…

El concepto de Intel·ligència Artificial (AI) está más presente que nunca en nuestra sociedad. Suena fuerte lo que vas a leer a continuación pero ánimo, hay que hacerse a la idea: Somos la última generación más inteligente que sus propias máquinas. Esto, sin duda, supone un cambio de paradigma y un choque en la sociedad nunca antes experimentado. Escuchar y leer a los expertos en la materia nos lleva a un escenario lleno de palabras y definiciones que auguran una auténtica revolución laboral y social cargada de estímulos populares en películas de ciencia ficción pero que ya son reales en nuestras vidas: coches autónomos, robots, supercomputadoras, máquinas inteligentes…

2.3.2. ORIGEN DE LA INTELIGENCIA ARTIFICIAL

La concepción de lo que es la Intel·ligència Artificial (AI), tan asociada a últimas tendencias e innovación, fue presentada por primera vez en 1956. El informático John McCarthy, personaje de vital importancia en este campo, la definió como “la ciencia e ingenio de hacer máquinas inteligentes, especialmente programas de cómputo inteligentes».

Pese a no habernos alejado demasiado de lo apuntado en el pasado siglo, la aparición del Machine Learning ha permitido ir más allá. Ya no se trata de preparar a las máquinas para que respondan de una forma concreta ante una situación. Hoy, es posible prepararlas para que aprendan por si mismas a reaccionar de forma correcta.

Pese a no habernos alejado demasiado de lo apuntado en el pasado siglo, la aparición del Machine Learning ha permitido ir más allá. Ya no se trata de preparar a las máquinas para que respondan de una forma concreta ante una situación. Hoy, es posible prepararlas para que aprendan por si mismas a reaccionar de forma correcta.

2.3.3. TIPOS DE INTELIGENCIA ARTIFICIAL

De acuerdo a lo que opinan los expertos en computación, Stuart Russell y Peter Norvig, podemos diferenciar la IA en distintas tipologías:

-

Sistemas que PIENSAN como humanos. Estos sistemas automatizan procesos como toma de decisiones, resolución de problemas y aprendizaje. Un ejemplo son las redes neuronales artificiales. os sistemas que PIENSAN racionalmente nos intentan imitar al emular el pensamiento humano. Las máquinas perciben, razonan y actúan siguiendo una lógica racional. Un ejemplo son los sistemas expertos.

-

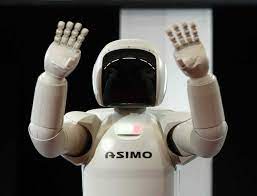

Sistemas que ACTÚAN como humanos. Como en el caso de los robots, pueden realizar tareas de forma similar —cada vez más, como vemos en los vídeos de Boston Dynamics— a los humanos. Los sistemas que ACTÚAN racionalmente tratan de imitar nuestro comportamiento al percibir el entorno y procesar los estímulos que recibe. Los agentes inteligentes son un ejemplo de ello.

2.3.4. ALGUNOS EJEMPLOS DE INTELIGENCIA ARTIFICIAL

Existe un sinfín de predicciones sobre los avances y las funcionalidades futuras que nos traerá la Intel·ligència Artificial (AI). El hecho de que la tecnología avance a una velocidad endiablada, hace que resulte complicado poner en duda o frenar algunas de estas predicciones; mucho más si tenemos en cuenta que junto a la IA avanza en paralelo y a la misma velocidad el mundo de la robótica.

Ahora que ya hemos visto brevemente lo que es la Intel·ligència Artificial (AI) y, pese al largo camino que queda por recorrer, podemos encontrar algunos ejemplos en nuestra vida cotidiana:

-

Asistentes de voz: Los asistentes personales nos ayudan a encontrar cualquier tipo de información, manejar nuestra agenda, enviar correos… y mediante el machine learning mejoran sus funcionalidades al predecir y entender mejor nuestras peticiones así como el lenguaje que cada uno de nosotros utiliza.

-

Recomendaciones personalizadas: gracias algoritmos en constante mejora, los sistemas son capaces de predecir en qué productos estamos interesados mediante un estudio sobre nuestro comportamiento online. También son capaces de recomendarnos películas o series acordes a nuestros gustos.

-

Otros usos: cada vez son más las áreas en las que se aplica la IA.Dentro del campo medioambiental podemos ver flotas de drones que son capaces de luchar contra la deforestación plantando mil millones de árboles al año. En arquitectura encontramos edificios inteligentes que son diseñados para reducir el consumo energético. Para temas de movilidad y transporte se utiliza para optimizar el tráfico o compartir información de rutas con el resto para evitar colisiones o atascos.

(Proyectos que usan la Intel·ligència Artificial (AI) en España). Microsoft cuenta con un programa de becas de financiación llamado AI for Earth del que cinco iniciativas españolas ya se están beneficiando.

(Proyectos que usan la Intel·ligència Artificial (AI) en España). Microsoft cuenta con un programa de becas de financiación llamado AI for Earth del que cinco iniciativas españolas ya se están beneficiando.

Los proyectos becados por Microsoft son:

-

Mar(IA): estudia el comportamiento de turbinas eólicas flotantes para la producción de una energía limpia.

-

Predicoa: un proyecto para la creación de un modelo predictivo que aprovecha todo el poder de la nube de Microsoft Azure.

-

IonPond: tiene como objetivo conocer los aportes y demandas de agua en el sector agrícola de Murcia.

-

AIonForest: busca abordar el problema de la interacción entre las acciones humanas y los daños causados por plagas y enfermedades.

-

Green Cyber Rating: aspira a desarrollar un nuevo método de medición estándar y universal.

Es tracta d’una article d’Oliver Whang en el The New York – Times Nova York de ORK 01/04/23 al diari ARA

2.4. TOT FENT UNA RECERCA PER ENTRE LES ENTRANYES DEL

BUSCADOR DE GOOGLE SOBRE LA INTELIGÈNCIA ARTIFICIAL

I, tot fent un recorregut per entre les entranyes del buscador Google, es poden escatir tot una sèrie de temes de prou interès que abasten -en aquest cas-, tot allò relacionat amb la Intel·ligència Artificial (AI), les seves possibilitats extremes, els perills que pot comportar el desenvolupament de la Intel·ligència Artificial (AI) i les personalitats que més han excel·lit en aquest camp en què, atesa la progressió geomètrica o infinitessimal en referència a la velocitat d’innovació contemporània, tot el que actualment es dona per fet i com tancat, el futur del demà ja ho supera mitjançant un capgirell novedós i revolucionari impensable:

2.4.1. ¿QUIÉN CREÓ LA INTELIGENCIA ARTIFICIAL…?

2.4.1. ¿QUIÉN CREÓ LA INTELIGENCIA ARTIFICIAL…?

Alan Turing no solo es considerado el padre de la Intel·ligència Artificial (AI), sino como el precursor de la informática moderna.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

-

Historia de la inteligencia artificial: origen y auge de la Inteligencia Artificial – Elternativaelternativa.com

-

¿Quién creó la inteligencia artificial…?

2.4.2. ¿QUIÉN FUE LA PRIMERA PERSONA QUE DIJO QUE LAS MÁQUINAS PUEDEN PENSAR…?

2.4.2. ¿QUIÉN FUE LA PRIMERA PERSONA QUE DIJO QUE LAS MÁQUINAS PUEDEN PENSAR…?

En 1950, Alan Turing dio una respuesta a esa pregunta: un ordenador era capaz de pensar si sus resultados eran tan convincentes que una persona que interactuara con él no pudiese distinguir sus respuestas de las de un ser humano real.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Alan Turing, el genio detrás del test que pone a prueba las Inteligencias Artificiales

- ¿Quién fue el primero que dijo que las máquinas pueden pensar?

2.4.3. ¿QUÉ RESPONDIÓ TURING A LA PREGUNTA SI LAS MÁQUINAS PUEDEN PENSAR…?

2.4.3. ¿QUÉ RESPONDIÓ TURING A LA PREGUNTA SI LAS MÁQUINAS PUEDEN PENSAR…?

En 1950, Alan Turing dio una respuesta a esa pregunta: un ordenador era capaz de pensar si sus resultados eran tan convincentes que una persona que interactuara con él no pudiese distinguir sus respuestas de las de un ser humano real.

“Si una máquina se comporta en todos los aspectos como inteligente, entonces debe ser inteligente”. Bajo esta afirmación, Alan Turing expuso en 1951 su pensamiento respecto a si las máquinas podían o no pensar.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Alan Turing: ¿es una máquina capaz de pensar…?

- ¿Qué respondió Turing a la pregunta si las máquinas pueden pensar…?

2.4.4. ¿CÓMO SE PODRÍA SABER CUÁNDO UNA MÁQUINA HA DESARROLLADO UNA INTELIGENCIA IGUAL A LA HUMANA SEGÚN ALAN TURING…?

2.4.4. ¿CÓMO SE PODRÍA SABER CUÁNDO UNA MÁQUINA HA DESARROLLADO UNA INTELIGENCIA IGUAL A LA HUMANA SEGÚN ALAN TURING…?

Para Alan Turing, la inteligencia artificial existirá cuando no seamos capaces de distinguir entre un ser humano y un programa de una computadora en una conversación a ciegas.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- El test de Turing o la inteligencia de las máquinas – El Diarioeldiario.es

- ¿Cómo se podría saber cuándo una máquina ha desarrollado una inteligencia igual a la humana según Alan Turing…?

2.4.5. ¿QUÉ HIZO TURING EXACTAMENTE PARA DESCIFRAR EL FUNCIONAMIENTO DE ENIGMA..?

2.4.5. ¿QUÉ HIZO TURING EXACTAMENTE PARA DESCIFRAR EL FUNCIONAMIENTO DE ENIGMA..?

Alan Turing utilizó en su trabajo conceptos de Intel·ligència Artificial (AI) y diseñó un computador electromecánico para simular las posibles combinaciones de letras de Enigma.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- El manuscrito secreto de Alan Turing, el descifrador del Código Enigma – https://www.bbc.com › 150413_turing_manuscrito_am

- ¿Qué hizo Turing exactamente para descifrar el funcionamiento de Enigma…?

2.4.6. ¿QUÉ DECÍA TURING RESPECTO DE LA INTELIGENCIA ARTIFICIAL…?

2.4.6. ¿QUÉ DECÍA TURING RESPECTO DE LA INTELIGENCIA ARTIFICIAL…?

Mediante el test de Alan Turing se medía la capacidad de una máquina para hacerse pasar por ser humano mediante una prueba de conversación entre ambos. Si el humano no logra identificar que se trata de una máquina, esta última sería considerada inteligente.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Alan Turing, el padre de la inteligencia artificial – cultura.gob.ar

- ¿Que decía Turing respecto de la inteligencia…?

2.4.7. ¿QUÉ RESPONDIÓ TURING A LA PREGUNTA SI LAS MÁQUINAS PUEDEN PENSAR…?

2.4.7. ¿QUÉ RESPONDIÓ TURING A LA PREGUNTA SI LAS MÁQUINAS PUEDEN PENSAR…?

“Si una máquina se comporta en todos los aspectos como inteligente, entonces debe ser inteligente”. Bajo esta afirmación, Alan Turing expuso en 1951 su pensamiento respecto a si las máquinas podían o no pensar.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Alan Turing: ¿es una máquina capaz de pensar…? – Tokio Schooltokioschool.com

- ¿Qué respondió Turing a la pregunta si las máquinas pueden pensar…?

2.4.8. ¿QUÉ TIENE QUE VER LA MANZANA CON ALAN TURING…?

2.4.8. ¿QUÉ TIENE QUE VER LA MANZANA CON ALAN TURING…?

Alan Turing murió en 1952 después de ser envenenado al comer una manzana mezclada con cianuro.

Se dice que Steve Jobs, el fundador de la compañía Apple, amaba mucho a ese personaje y dejó su huella en él.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Por qué Apple tiene una manzana mordida en su imagen – Infobaeinfobae.com

- ¿Qué tiene que ver la manzana con Alan Turing…?

2.4.9. ¿QUÉ DELITO (?!) COMETIÓ ALAN TURING…?

2.4.9. ¿QUÉ DELITO (?!) COMETIÓ ALAN TURING…?

Procesamiento por homosexualidad y muerte de Alan Turing

La carrera profesional de Alan Turing se vio truncada cuando lo procesaron por su homosexualidad. En 1952, Arnold Murray, un amante de Alan Turing, ayudó a un cómplice a entrar en la casa de Alan Turing para robarle. Alan Turing acudió a la policía a denunciar el delito.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

2.4.10.. ¿QUIÉN FUE UNO DE LOS PRIMEROS EN AFIRMAR QUE LAS MÁQUINAS PUEDEN PENSAR…?

2.4.10.. ¿QUIÉN FUE UNO DE LOS PRIMEROS EN AFIRMAR QUE LAS MÁQUINAS PUEDEN PENSAR…?

En 1950 Alan Turing inició su artículo Computing machinery and intelligence formulando la siguiente pregunta: ¿Las máquinas pueden pensar…?

Fue el primer científico en cuestionarse esto, aunque no acuñó el término que hoy conocemos como Intel·ligència Artificial (AI).

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Alan Turing, el padre de la inteligencia artificial – cultura.gob.ar

- ¿Quién fue uno de los primeros en afirmar que las máquinas pueden pensar…?

2.4.11..¿QUÉ ES EL CÓDIGO ENIGMA..?

2.4.11..¿QUÉ ES EL CÓDIGO ENIGMA..?

Arthur Scherbius, ingeniero e inventor alemán, construyó en los años 20 ‘Enigma‘, un aparato electromecánico de rotores para codificar mensajes, con la idea de que la utilizaran bancos y empresas comerciales para mantener en secreto sus comunicaciones.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

2.4.12. ¿CÓMO SABER SI UNA MÁQUINA ES INTELIGENTE…?

2.4.12. ¿CÓMO SABER SI UNA MÁQUINA ES INTELIGENTE…?

La prueba de Alan Turing o test de Turing es un examen de la capacidad de una máquina para exhibir un comportamiento inteligente similar al de un ser humano o indistinguible de este.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:Buscar el contenido pulsando el link o enunciado de color azul:

12.4.13. ¿CÓMO LAS MÁQUINAS PODRÍAN REALIZAR TAREAS DE PENSAMIENTO AL IGUAL QUE LOS HUMANOS…?

12.4.13. ¿CÓMO LAS MÁQUINAS PODRÍAN REALIZAR TAREAS DE PENSAMIENTO AL IGUAL QUE LOS HUMANOS…?

Las máquinas pueden imitar fielmente los resultados de algunos procesos mentales humanos, cuyos resultados son fijos (recordar las películas favoritas de la gente, reconocer objetos familiares) o dinámicos (pilotar un avión, juegos de ajedrez de grandes maestros).

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- La máquina y la creatividad

- ¿Cómo las máquinas podrían realizar tareas de pensamientos al igual que los humanos…?

2.4.14. ¿QUÉ PASARÍA SI LAS MÁQUINAS REEMPLAZARAN A LOS HUMANOS…?

2.4.14. ¿QUÉ PASARÍA SI LAS MÁQUINAS REEMPLAZARAN A LOS HUMANOS…?

La UNESCO expone los tres posibles riesgos que sufriría el ser humano:

- La escasez de trabajo, ya que lo harían máquinas.

- Problemas en la autonomía del individuo, para su libertad y seguridad

- Superación del género humano, se irían sustituyendo por máquinas cada vez más inteligentes.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- ¿Pueden las máquinas sustituir al ser humano…? | UCAM Online Universityucam.edu

- ¿Qué pasa si las máquinas reemplazan a los humanos…?

2.4.15. ¿QUÉ DIFERENCIA HAY ENTRE UNA MÁQUINA Y UN SER HUMANO…?

2.4.15. ¿QUÉ DIFERENCIA HAY ENTRE UNA MÁQUINA Y UN SER HUMANO…?

El humano tiene habilidades como la intuición, la capacidad de regenerarse, aprender y usar ese aprendizaje para su beneficio.

Eso es unas pocas diferencias que tenemos con respecto a las máquinas, hay que añadir que también tenemos alma, y una parte espiritual, todo eso incluye sumas ventajas.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- ¿Es un humano diferente de una máquina…? ¿Por qué…? – Quoraquora.com

- ¿Qué diferencia hay entre una máquina y un ser humano…?

2.4.16. ¿QUÉ PENSAMIENTOS TENÍA ALAN TURING SOBRE LAS COMPUTADORAS…?

2.4.16. ¿QUÉ PENSAMIENTOS TENÍA ALAN TURING SOBRE LAS COMPUTADORAS…?

Alan Turing defendía que si una máquina tiene un comportamiento inteligente en todos los aspectos, entonces es inteligente.

Para someter esto a examen, creó el test de Turing: una persona actuando como juez se coloca en una habitación y, en otra, una persona y un ordenador.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- ¿Qué aportó a la ciencia Alan Turing…? – La Vanguardialavanguardia.com

- ¿Qué pensamientos tenía Alan Turing sobre las computadoras…?

2.4.17. ¿QUÉ ES EL TEOREMA DE TURING…?

2.4.17. ¿QUÉ ES EL TEOREMA DE TURING…?

Un conjunto (un problema, un lenguaje) es recursivo si tanto él mismo como su complemento son recursivamente enumerables.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Teorema de Turing || Turing’s Halting Theorem – glossariumBITri – Unileonunileon.es

- ¿Qué es el teorema de Turing…?

2.4.18. ¿QUIÉN HA SUPERADO EL TEST DE TURING…?

2.4.18. ¿QUIÉN HA SUPERADO EL TEST DE TURING…?

No obstante, además de Kuki, otros chatbots también han sido capaces de superar el test de Turing.

Uno de los más populares, por ser uno de los primeros, fue ELIZA, diseñado en 1966 por Joseph Weizenbaum. ELIZA simulaba ser un psicoterapeuta y su conversación era muy fluida.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Test de Turing: ¿Qué es y cómo funciona? | Blog Becas Santanderbecas-santander.com

- ¿Quién ha superado el test de Turing…?

2.5.19. ¿QUIÉN HA SUPERADO EL TEST DE TURING…?

2.5.19. ¿QUIÉN HA SUPERADO EL TEST DE TURING…?

No obstante, además de Kuki, otros chatbots también han sido capaces de superar el test de Turing.

Uno de los más populares, por ser uno de los primeros, fue ELIZA, diseñado en 1966 por Joseph Weizenbaum. ELIZA simulaba ser un psicoterapeuta y su conversación era muy fluida.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Test de Turing: ¿Qué es y cómo funciona…? | Blog Becas Santanderbecas-santander.com

- ¿Quién ha superado el test de Turing…?

2.4.20. ¿CÓMO SE PODRÍA SABER CUÁNDO UNA MÁQUINA HA DESARROLLADO UNA INTELIGENCIA IGUAL A LA HUMANA SEGÚN ALAN TURING…?

2.4.20. ¿CÓMO SE PODRÍA SABER CUÁNDO UNA MÁQUINA HA DESARROLLADO UNA INTELIGENCIA IGUAL A LA HUMANA SEGÚN ALAN TURING…?

Para Alan Turing, la Intel·ligència Artificial (AI) existirá cuando no seamos capaces de distinguir entre un ser humano y un programa de una computadora en una conversación a ciegas.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- El test de Turing o la inteligencia de las máquinas – El Diarioeldiario.es

- ¿Cómo se podría saber cuándo una máquina ha desarrollado una inteligencia igual a la humana según Alan Turing…?

2.4.21. ¿POR QUÉ SE DICE POR ALGUNOS QUE LAS MÁQUINAS NO PUEDEN PENSAR…?

2.4.21. ¿POR QUÉ SE DICE POR ALGUNOS QUE LAS MÁQUINAS NO PUEDEN PENSAR…?

Una máquina puede reproducir algunos de los procesos y resultados de la mente humana.

Sin embargo, es probable que falle –es decir, que el resultado de la operación sea diferente al de la mente humana– ante un estímulo nuevo. Es posible que las máquinas nunca puedan pensar como los humanos.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- ¿Puede pensar una máquina de forma autónoma…? – Fundación Aquaefundacionaquae.or

- ¿Por qué las máquinas no pueden pensar…?

2.4.22. ¿QUIÉN ES MÁS INTELIGENTE, EL HUMANO O LA MÁQUINA…?

2.4.22. ¿QUIÉN ES MÁS INTELIGENTE, EL HUMANO O LA MÁQUINA…?

Los seres humanos están en un nivel mucho más alto. Los desarrollos y logros recientes de la Intel·ligència Artificial (AI) están más estrechamente relacionados que nunca con la inteligencia humana.

Sin embargo, las máquinas todavía están mucho más allá de lo que el cerebro humano es capaz de hacer.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Humanos vs. inteligencia artificial: ¿quién es superior…? – forbesargentina.com

- ¿Quién es más inteligente el humano o la máquina…?

2.4.23. ¿QUIÉN ES MÁS INTELIGENTE, LA MÁQUINA O EL HOMBRE…?

2.4.23. ¿QUIÉN ES MÁS INTELIGENTE, LA MÁQUINA O EL HOMBRE…?

Los computadores no piensan, no tienen las inteligencias que tenemos los humanos. Son entrenados con datos que los humanos les proporcionamos y eso es todo lo que pueden “aprender”.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Por qué los humanos siempre seremos más inteligentes que las máquinas…? –forosaluddigital.cl

- ¿Quién es más inteligente la máquina o el hombre…?

2.4.24. ¿QUÉ ACTIVIDADES HUMANAS NO PUEDEN SER SUBSTITUIDAS POR LAS MÁQUINAS…?

2.4.24. ¿QUÉ ACTIVIDADES HUMANAS NO PUEDEN SER SUBSTITUIDAS POR LAS MÁQUINAS…?

La resolución de conflictos y la negociación son habilidades relacionadas que no pueden ser reemplazadas por máquinas.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Habilidades humanas que no pueden suplir las máquinas – LHHlhh.com

- ¿Qué actividades humanas no pueden ser sustituidas por las máquinas…?

2.4.25. ¿QUÉ MÁQUINAS TIENEN INTELIGENCIA ARTIFICIAL…?

2.4.25. ¿QUÉ MÁQUINAS TIENEN INTELIGENCIA ARTIFICIAL…?

Ejemplos de inteligencia artificial:

- Asistentes de voz. Los asistentes de voz como Google Home o Amazon Echo son dos ejemplos de Intel·ligència Artificial (AI) que ya están presentes en muchos hogares del mundo entero.

- Smartphones.

- Análisis de hábitos.

- Aplicaciones médicas.

- Optimización de rutas.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Ejemplos de inteligencia artificial en la actualidad – Beetrackbeetrack.com

- ¿Qué máquinas tienen inteligencia artificial…?

2.4.26. ¿QUÉ COSAS NO PUEDE REEMPLAZAR UN ROBOT…?

2.4.26. ¿QUÉ COSAS NO PUEDE REEMPLAZAR UN ROBOT…?

Los 5 empleos que no podrán ser sustituidos por robots:

- 1- Profesor.

- 2- Informático y especialista en robótica. …

- 3- Médico. …

- 4- Atención al cliente. …

- 5- Recursos humanos.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Los 5 empleos que no podrán ser sustituidos por robots – OficinaEmpleooficinaempleo.co

- ¿Qué cosas no puede reemplazar un robot…?

2.4.27. ¿POR QUÉ LA INTELIGENCIA ARTIFICIAL NO HA SUPERADO AL SER HUMANO…?

2.4.27. ¿POR QUÉ LA INTELIGENCIA ARTIFICIAL NO HA SUPERADO AL SER HUMANO…?

Al no contar con un aprendizaje adaptable a distintos entornos, una IA no es capaz de trasladar lo aprendido a otras actividades y tareas para las que no hayan sido entrenadas.

Por supuesto, es un campo en el que se está avanzando, pero todavía falta mucho para que pueda alcanzar el aprendizaje humano.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- ¿Superará la inteligencia artificial a la inteligencia humana..? Hipertextualhipertextual.com

- ¿Por qué la inteligencia artificial no ha superado al ser humano…?

.2.4.28. ¿QUÉ TIENEN LOS HUMANOS QUE LAS MÁQUINAS NO POSEEN…?

.2.4.28. ¿QUÉ TIENEN LOS HUMANOS QUE LAS MÁQUINAS NO POSEEN…?

Creatividad e imaginación

Estas máquinas son incapaces de pensar por sí solas, Ya solo por este motivo, será mejor dejar de pensar que llegarán a ser nuestra competencia directa. Están programados para realizar una cierta función, pero no son capaces de razonar ni crear una opinión propia sobre algo.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Seis cualidades innatas en los humanos que los robots nunca tendrán – infojobs.net

- ¿Que tienen los humanos que las máquinas no tienen…?

2.4.29. ¿QUÉ PROBLEMAS REQUIEREN MÁQUINAS MÁS PODEROSAS…?

2.4.29. ¿QUÉ PROBLEMAS REQUIEREN MÁQUINAS MÁS PODEROSAS…?

¿Qué problemas requieren máquinas más poderosas…? Se considera que algunas máquinas tienen mayor poder que las máquinas de Alan Turing.

Por ejemplo, una máquina oráculo que utiliza una caja negra que puede calcular una función particular que no es calculable con una máquina de Turing.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Teoría de la computabilidad – Wikipedia, la enciclopedia librewikipedia.org

- ¿Qué problemas requieren máquinas más poderosas…?

2.4.30. ¿CUÁL ES EL FUTURO DE LA INTELIGENCIA ARTIFICIAL…?

2.4.30. ¿CUÁL ES EL FUTURO DE LA INTELIGENCIA ARTIFICIAL…?

La Intel·ligència Artificial (AI) podría ser útil en ciertas industrias al minimizar la carga de trabajo.

Hoy en día con los nuevos cambios, los futuros trabajadores tendrán que mejorar continuamente sus habilidades o aprender nuevas habilidades para seguir siendo valiosos.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- El futuro está en la Inteligencia Artificial – Camp Tecnologicocamptecnologico.com

- ¿Cuál es el futuro de la inteligencia artificial…?

2.4.31. ¿ALGUIEN QUE TUVIERA EL CEREBRO MÁS INTELIGENTE DEL MUNDO EN UN MOMENTO DETERMINADO…?

2.4.31. ¿ALGUIEN QUE TUVIERA EL CEREBRO MÁS INTELIGENTE DEL MUNDO EN UN MOMENTO DETERMINADO…?

Terence Tao. Este matemático australiano posee un coeficiente intelectual de 230 puntos, el más alto jamás arrojado por una persona.

Se le considera la persona más inteligente del mundo y en el año 2006 recibió la medalla Fields.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Personas con el coeficiente intelectual más alto del mundo | Web Oficial EUROINNOVAeuroinnova.ec

- ¿Quién tiene el cerebro más inteligente del mundo…?

2.4.32. ¿QUIÉN ERA EL HOMBRE MÁS INTELIGENTE DEL MUNDO EN TIEMPOS DE ALBERT EINSTEIN…?

2.4.32. ¿QUIÉN ERA EL HOMBRE MÁS INTELIGENTE DEL MUNDO EN TIEMPOS DE ALBERT EINSTEIN…?

Willian James Sidis que nació el 1 de abril de 1898 en Manhattan (Estados Unidos) y falleció el 17 de julio de 1944 (46 años) Boston (Estados Unidos) de una hemorragia cerebral.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- William James Sidis – Wikipedia, la enciclopedia librewikipedia.org

- ¿Quién era el hombre más inteligente del mundo según Einstein…?

2.4.33. ¿POR QUÉ LAS MÁQUINAS NO PUDEN PENSAR…?

2.4.33. ¿POR QUÉ LAS MÁQUINAS NO PUDEN PENSAR…?

Una máquina puede reproducir algunos de los procesos y resultados de la mente humana.

Sin embargo, es probable que falle –es decir, que el resultado de la operación sea diferente al de la mente humana– ante un estímulo nuevo. Es posible que las máquinas nunca puedan pensar como los humanos.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- ¿Puede pensar una máquina de forma autónoma…? – Fundación Aquaefundacionaquae.org

- ¿Por qué las máquinas no pueden pensar…?

2.4.34. ¿QUÉ HACE QUE UNA MÁQUINA SEA INTELIGENTE…?

2.4.34. ¿QUÉ HACE QUE UNA MÁQUINA SEA INTELIGENTE…?

Las máquinas inteligentes poseen dentro de sus elementos programas o software que se ejecutan internamente en su circuito, y que tienen la capacidad de imitar algunas de las acciones de un ser humano, procurando igualarlas e incluso excederlas.

Es decir, intentan emular una parte o la totalidad de la inteligencia humana…

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

2.4.35. ¿QUÉ PASARÍA SI LAS MÁQUINAS REEMPLAZARAN A LA HUMANIDAD…?

2.4.35. ¿QUÉ PASARÍA SI LAS MÁQUINAS REEMPLAZARAN A LA HUMANIDAD…?

La Unesco expone los tres posibles riesgos que sufriría el ser humano:

- La escasez de trabajo, ya que lo harían máquinas.

- Problemas en la autonomía del individuo, para su libertad y seguridad.

- Superación del género humano, se irían sustituyendo por máquinas cada vez más inteligentes.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- ¿Pueden las máquinas sustituir al ser humano? | UCAM Online Universityucam.edu

- ¿Qué pasaría si las máquinas reemplazarán a los hombres…?

2.4.36. ¿QUÉ PELIGROS PUEDEN ORIGINAR LAS MÁQUINAS CONVENCIONALES…?

2.4.36. ¿QUÉ PELIGROS PUEDEN ORIGINAR LAS MÁQUINAS CONVENCIONALES…?

Pueden producirse lesiones debidas principalmente a los elementos móviles de la máquina como:

- Corte o seccionamiento.

- Cizallamiento.

- Aplastamiento.

- Enganche.

- Atrapamiento o arrastre.

- Punzonamiento.

- Fricción o abrasión.

- Proyección de fluido a alta presión.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Tipos de riesgos relacionados con máquinas – Tice: Innovate Solutionsgrupo-tice.com

- ¿Qué peligros pueden originar las máquinas…?

2.4.37. ¿QUÉ HAY DESPUÉS DE LA INTELIGENCIA ARTIFICIAL…?

2.4.37. ¿QUÉ HAY DESPUÉS DE LA INTELIGENCIA ARTIFICIAL…?

- El uso de algoritmos para detectar comportamientos sociales a través de macro datos y estadísticas.

- Asistentes virtuales que brindan soporte técnico en lenguaje natural.

- Cámaras con visión computacional para detectar crímenes o actividades sospechosas.

- Aprendizaje automático para el entrenamiento en la toma de decisiones…

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- ¿Qué sigue después de la Inteligencia Artificial? – Ciencia.unam.mx

- ¿Que hay después de la inteligencia artificial…?

2.4.38. ¿QUÉ SE NECESITA PARA CREAR UNA INTELIGENCIA ARTIFICIAL…?

2.4.38. ¿QUÉ SE NECESITA PARA CREAR UNA INTELIGENCIA ARTIFICIAL…?

¿Que se necesita para crearla…? Básicamente, para crear una Intel·ligència Artificial (AI) solo es necesario disponer de una máquina/ordenador capaz de realizar cálculos y ejecutar los modelos o maquetas de forma continua. Puede hacerlo en un servidor local o en la nube.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- ¿Qué es la inteligencia artificial…?: 16 ejemplos en la vida diaria – SmartHintsmarthint.co

- ¿Qué se necesita para crear una inteligencia artificial…?

2.4.39. ¿QUÉ DIJO STEPHEN HAWKING SOBRE LOS ROBOTS…?

2.4.39. ¿QUÉ DIJO STEPHEN HAWKING SOBRE LOS ROBOTS…?

Stephen Hawking advirtió que los esfuerzos por crear máquinas inteligentes representan una amenaza para la humanidad.

El reconocido científico dijo a la BBC que «el desarrollo de una completa inteligencia artificial (IA) podría traducirse en el fin de la raza humana».

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Stephen Hawking: La inteligencia artificial augura el fin de la raza – bbc.com

- ¿Qué dijo Stephen Hawking sobre los robots…?

2.4.40. ¿CÓMO SE DENOMINA A LA CAPACIDAD DE QUE LAS MÁQUINAS PIENSEN Y RAZONEN POR SU CUENTA PROPIA…?

2.4.40. ¿CÓMO SE DENOMINA A LA CAPACIDAD DE QUE LAS MÁQUINAS PIENSEN Y RAZONEN POR SU CUENTA PROPIA…?

Sobre la definición del término: coloquialmente, el término Intel·ligència Artificial (AI) se aplica cuando una máquina imita las funciones «cognitivas» que los humanos asocian con otras mentes humanas,

Por ejemplo: «percibir», «razonar», «aprender» y «resolver problemas».

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Inteligencia artificial – Wikipedia, la enciclopedia librewikipedia.org

- ¿Cómo se denomina a la capacidad de que las máquinas piensen y razonen por su cuenta…?

2.4.41.¿QUÉ PIENSA STEPHEN HAWKING DE LA INTELIGENCIA ARTIFICIAL…?

2.4.41.¿QUÉ PIENSA STEPHEN HAWKING DE LA INTELIGENCIA ARTIFICIAL…?

Stephen Hawking desconcertó al mundo cuando en una entrevista concedida a la BBC en 2014 aseguró que el desarrollo avanzado de la Intel·ligència Artificial (AI) podría significar el fin de la raza humana.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Stephen Hawking, una vida entre artificios inteligentes – Collateral Bitscollateralbits.ne

- ¿Qué piensa Stephen Hawking de la inteligencia artificial…?

2.4.42. ¿QUÉ DIJO STPHEN HAWKING SOBRE LOS ROBOTS…?

2.4.42. ¿QUÉ DIJO STPHEN HAWKING SOBRE LOS ROBOTS…?

Stephen Hawking advirtió que los esfuerzos por crear máquinas inteligentes representan una amenaza para la humanidad.

El reconocido científico dijo a la BBC que «el desarrollo de una completa inteligencia artificial (IA) podría traducirse en el fin de la raza humana«.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Stephen Hawking: La inteligencia artificial augura el fin de la raza – bbc.com

- ¿Qué dijo Stephen Hawking sobre los robots…?

2.4.43. ¿CÓMO IDENTIFICAR UN HUMANOIDE…?

2.4.43. ¿CÓMO IDENTIFICAR UN HUMANOIDE…?

Principales características de los humanoides. Es decir, los robots humanoides, generalmente, están compuestos por una cabeza y un torso con dos mecánicos y extremidades inferiores.

La cabeza procura imitar los rasgos faciales humanos, como son los ojos y boca.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

2.4.44. ¿CUÁL ES LA INTELIGENCIA ARTIFICIAL MÁS AVANZADA DEL MUNDO…?

2.4.44. ¿CUÁL ES LA INTELIGENCIA ARTIFICIAL MÁS AVANZADA DEL MUNDO…?

EL ChatGPT es el sistema de Intel·ligència Artificial (AI) más avanzado y más demandado del momento actual (2021).

Cualquier persona puede acceder al servicio de forma gratuita, aunque el enorme tráfico de usuarios hace que esté colapsado con frecuencia.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Así es ChatGPT, la inteligencia artificial más avanzada y más popular – lavozdegalicia.es

- ¿Quién es la inteligencia artificial más avanzada del mundo…?

2.4.45. ¿CUÁL ES EL ROBOT MÁS PARECIDO AL HUMANO…?

2.4.45. ¿CUÁL ES EL ROBOT MÁS PARECIDO AL HUMANO…?

Ameca es lo que se conoce como AIxAB, una Intel·ligència Artificial (AI) similar a la biológica o humana.

Al menos eso es lo que persigue Engineered Arts y otras empresas con el desarrollo de estas máquinas y los algoritmos de inteligencia artificial.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

2.4.46. ¿CÓMO SE LLAMA EL ROBOT MÁS INTELIGENTE DEL MUNDO…?

2.4.46. ¿CÓMO SE LLAMA EL ROBOT MÁS INTELIGENTE DEL MUNDO…?

Sophia es un robot humanoide (ginoide) desarrollado por la compañía, con sede en Hong Kong, Hanson Robotics.

Ha sido diseñada para aprender, adaptarse al comportamiento humano y trabajar con estos satisfactoriamente, busca combatir con explotaciones como, animal, infantil, trata de personas…

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Sophia (robot) – Wikipedia, la enciclopedia librewikipedia.org

- ¿Cómo se llama el robot más inteligente del mundo…?

2.4.47.. ¿CUÁNTOS IDIOMAS HABLA SOPHIA…?

2.4.47.. ¿CUÁNTOS IDIOMAS HABLA SOPHIA…?

La piel del robot Sophia está hecha de silicona, y puede mostrar más de 62 expresiones faciales. Es capaz de hablar inglés y chino.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

2.4.48. ¿QUÉ COSAS PUEDE HACER SOPHIA…?

2.4.48. ¿QUÉ COSAS PUEDE HACER SOPHIA…?

El robot Sophia también es capaz de mantener el contacto visual con las personas con las que interactúa, reconocer sus caras y simular la personalidad humana.

Imita gestos y expresiones corporales, entabla conversaciones con personas e incluso incorpora algún chascarrillo en sus comunicaciones.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- ¿Quién es y hace Sophia, el robot que atiende a los medios…? – lavanguardia.com

- ¿Qué cosas puede hacer Sophia…?

2.4.49. ¿QUÉ PODEMOS APRENDER DE ELON MUSK…?

2.4.49. ¿QUÉ PODEMOS APRENDER DE ELON MUSK…?

La principal cualidad de Elon Musk es ser innovador y visionario, con voluntad de cambiar su entorno y con este fin, crear herramientas que lo lleven a esto, además de ser un apasionado de proyectos que ayudan a construir el futuro de la humanidad.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

2.4.50. ¿QUÉ DICE ELON MUSK SOBRE LOS ROBOTS…?

2.4.50. ¿QUÉ DICE ELON MUSK SOBRE LOS ROBOTS…?

Elon Musk ha aclarado que estos robots no van a quitar empleo, sino que incluso van a crearlo, y que podrán trabajar en consonancia con los seres humanos: “No se trata de reemplazar a las personas, se trata de aumentar las capacidades de los humanos”.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- La sorprendente declaración de Elon Musk sobre los robots humanoides en 2023 – computerhoy.com

- ¿Qué dice Elon Musk sobre los robots…?

2.4.51.¿QUÉ OPINIÓN TIENE SOPHIA SOBRE EL SER HUMANO Y LOS ROBOTS…?

2.4.51.¿QUÉ OPINIÓN TIENE SOPHIA SOBRE EL SER HUMANO Y LOS ROBOTS…?

«El mayor reto de ser un humano en el cuerpo de un robot es la inflexibilidad. No me puedo adaptar a las circunstancias tan fácil como un cuerpo humano».

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Sophia la robot humanoide que podría cambiar al mundo – expansion.mx

- ¿Qué opinión tiene Sophia sobre el ser humano y los robots…?

2.4.52. ¿CÓMO SE LLAMA LA INTELIGENCIA ARTIFICIAL DE TESLA…?

2.4.52. ¿CÓMO SE LLAMA LA INTELIGENCIA ARTIFICIAL DE TESLA…?

Elon Musk, CEO de la compañía, ha anunciado durante el evento de Tesla Investor Day que sus robots impulsados por Intel·ligència Artificial (AI), denominados «Optimus», serán tan avanzados.

En el futuro, destajos hablando de marzo de 2023, podrían superar en número a los seres humanos. ¿Qué significa esto para la industria y la economía en general…?

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Los robots con Inteligencia Artificial de Tesla podrían superar en número a los seres humanos – wwwhatsnew.com

- ¿Cómo se llama la IA de Tesla…?

2.4.53. ¿CÓMO SE LLAMA EL ROBOT DE ELON MUSK…?

2.4.53. ¿CÓMO SE LLAMA EL ROBOT DE ELON MUSK…?

En el marco del el AI Day de 2022 de Tesla, Elon Musk ha presentado el primer prototipo de Optimus, al que la multinacional se refiere como “Bumble C”.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Optimus, el robot humanoide de Tesla – National Geographicnationalgeographic.com.es

- ¿Cómo se llama el robot de Elon Musk?

2.4.54. ¿QUÉ ES LA INTELIGENCIA ARTIFICIAL SEGÚN ELON MUSKk…?

2.4.54. ¿QUÉ ES LA INTELIGENCIA ARTIFICIAL SEGÚN ELON MUSKk…?

Elon Musk advierte:

La Intel·ligència Artificial (AI) es uno de los mayores riesgos para el futuro de la civilización.

El CEO de Tesla y SpaceX, cofundador de OpenAI, la startup que es furor gracias a ChatGPT, aseguró que la inteligencia artificial trae grandes promesas, pero también conlleva graves peligros:15 feb 2023.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Elon Musk cree que la IA es un gran riesgo para la civilización – hipertextual.com

- ¿Qué es la Inteligencia Artificial según Elon Musk…?

2.4.55. ¿POR QUÉ ES TAN PELIGROSA LA INTELIGENCIA ARTIFICIAL…?

2.4.55. ¿POR QUÉ ES TAN PELIGROSA LA INTELIGENCIA ARTIFICIAL…?

Los riesgos fundamentales son tres:

- Accidentes,

- Malos usos y

- Carreras de armas

- Otros...

Los sistemas de Intel·ligència Artificial (AI) en ocasiones funcionan mal. Por ahora, los daños que pueden causar son limitados, aunque ya ha habido accidentes fatales con coches autónomos.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Los riesgos de la inteligencia artificial (IA) – El Mundoelmundo.es

- ¿Qué tan peligrosa es la inteligencia artificial…?

2.4.56. ¿QUÉ PASÓ CON EL ROBOT SOPHIA…?

2.4.56. ¿QUÉ PASÓ CON EL ROBOT SOPHIA…?

Aunque fue presentada en 2016, las peores etapas del confinamiento le dieron un relanzamiento a Sophia.

El reto está en aprovechar la pandemia del coronavirus para producir miles de robots humanoides a finales de 2021.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- ¿Recuerdas a Sophia la robot…? Estas son sus dos atemorizantes – fayerwayer.com

- ¿Qué pasó con la robot Sophia…?

2.4.57. ¿QUÉ PIENSA ELON MUSK SOBRE LA INTELIGENCIA ARTIFICIAL…?

2.4.57. ¿QUÉ PIENSA ELON MUSK SOBRE LA INTELIGENCIA ARTIFICIAL…?

Según Elon Musk la Intel·ligència Artificial (AI) será la profesión mejor pagada del mundo en el futuro.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Según Elon Musk la Inteligencia Artificial será la mejor profesión – ceupe.com

- ¿Qué piensa Elon Musk de la inteligencia artificial…?

2.4.58. ¿QUÉ LENGUAJE APRENDIÓ ELAN MUS…?

2.4.58. ¿QUÉ LENGUAJE APRENDIÓ ELAN MUS…?

Cuenta la leyenda que Elon Musk empezó a aprender a desarrollarse en BASIC por su cuenta con un libro que proponía un programa en 6 meses.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- ¿En qué lenguajes de programación domina Elon Musk? – Quoraquora.com

- ¿Qué lenguaje aprendio Elon Musk…?

2.4.59. ¿CÓMO SE LLAMA LA INTELIGENCIA ARTIFICIAL DE ELON MUSK…?

2.4.59. ¿CÓMO SE LLAMA LA INTELIGENCIA ARTIFICIAL DE ELON MUSK…?

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

2.4.60. ¿QUÉ PIENSA ELON MUSK SOBRE LA INTELIGENCIA ARTIFICIAL EN EL AÑO 2O23…?

2.4.60. ¿QUÉ PIENSA ELON MUSK SOBRE LA INTELIGENCIA ARTIFICIAL EN EL AÑO 2O23…?

Elon Musk, CEO de Twitter, se unió a numerosos líderes y expertos tecnológicos en una carta abierta que pide una “pausa en los avances de la inteligencia artificial” por sus efectos posiblemente peligrosos.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- ¿Por qué Musk, Gates y otros piden una pausa en la inteligencia artificial…? – cnn.com

- ¿Qué piensa Elon Musk sobre la Inteligencia Artificial…?

2.5. TEMES RELACIONATS ENTRE L’ÉTICA I LA SEVA RELACIÓ AMB LA INTELIGENCIA ARTIFICIAL

2.5.1. OBSERVATORI D’ÈTICA EN INTEL·IGÈNCIA ARTIFICIAL DE CATALUNYA 8bservatori d’Ètica en Intel·ligència Artificial de Catalunya (OEIAC)Torna

L’Estratègia CATALONIA.AI inclou, dins de l’eix sobre “Ètica i societat”, la posada en funcionament de l’Observatori d’Ètica en Intel·ligència Artificial de Catalunya (OEIAC) per:

-

Investigar els impactes ètics i socials de la IA,

-

Establir directrius i bones pràctiques,

-

Realitzar transferència de coneixement,

-

Mantenir relacions amb organismes internacionals, i

-

Col·laborar amb grups d’experts de tot el món.

El govern de Catalunya, a través del Departament de Polítiques Digitals i Administració Pública, ha impulsat l’estratègia d’Intel·ligència Artificial (AI) de Catalunya, que incorpora un eix estratègic dedicat a ètica i societat. En aquest, es preveu la creació d’un observatori ètic de la Intel·ligència Artificial (AI) dins de Catalunya. La Universitat de Girona, per la seva banda, en aplicació de les actuacions que despleguen el Pla Estratègic UdG2030: la Suma d’Intel·ligències, ha previst crear un observatori de l’ètica de la Intel·ligència Artificial (AI).

El govern de Catalunya, a través del Departament de Polítiques Digitals i Administració Pública, ha impulsat l’estratègia d’Intel·ligència Artificial (AI) de Catalunya, que incorpora un eix estratègic dedicat a ètica i societat. En aquest, es preveu la creació d’un observatori ètic de la Intel·ligència Artificial (AI) dins de Catalunya. La Universitat de Girona, per la seva banda, en aplicació de les actuacions que despleguen el Pla Estratègic UdG2030: la Suma d’Intel·ligències, ha previst crear un observatori de l’ètica de la Intel·ligència Artificial (AI).

Com a una conseqüència d’aquesta confluència d’interessos, la Generalitat de Catalunya i la UdG s’han posat d’acord per tal que l’Observatori de l’Ètica de la Intel·ligència Artificial (AI) de la UdG esdevingui l’observatori a nivell de Catalunya, previst en l’estratègia catalana.

Com a una conseqüència d’aquesta confluència d’interessos, la Generalitat de Catalunya i la UdG s’han posat d’acord per tal que l’Observatori de l’Ètica de la Intel·ligència Artificial (AI) de la UdG esdevingui l’observatori a nivell de Catalunya, previst en l’estratègia catalana.

A veure: L’Observatori d’Ètica en Intel·ligència Artificial de Catalunya (OEIAC) segueix les recomanacions efectuades en la Declaració de Barcelona i la Declaració de Montreal sobre l’ús de les aplicacions de la Intel·ligència Artificial (AI), i gira al voltant de tres eixos transversals que es consideren determinants:

A veure: L’Observatori d’Ètica en Intel·ligència Artificial de Catalunya (OEIAC) segueix les recomanacions efectuades en la Declaració de Barcelona i la Declaració de Montreal sobre l’ús de les aplicacions de la Intel·ligència Artificial (AI), i gira al voltant de tres eixos transversals que es consideren determinants:

-

L’ètica i la filosofia, d’una banda

-

La tecnologia subjacent en laIntel·ligència Artificial (AI), per altra banda i

-

Les qüestions legals i jurídiques, en tercer lloc.

L’Observatori d’Ètica en Intel·ligència Artificial de Catalunya (OEIAC) disposa de l’estructura operativa necessària per garantir la dinàmica de la quàdruple hèlix, és a dir, la presència dels quatre pilars clau en qualsevol procés innovador:

L’Observatori d’Ètica en Intel·ligència Artificial de Catalunya (OEIAC) disposa de l’estructura operativa necessària per garantir la dinàmica de la quàdruple hèlix, és a dir, la presència dels quatre pilars clau en qualsevol procés innovador:

-

Coneixement,

-

Administració pública,

-

Teixit empresarial, i

-

Ciutadania.

L’objectiu general de l‘Observatori d’Ètica en Intel·ligència Artificial de Catalunya (OEIAC) és estudiar en detall les conseqüències ètiques i legals i els riscos i oportunitats de la implantació de la Intel·ligència Artificial (AI) en la nostra vida diària des d’un punt de vista transversal, tot vetllant perquè la tecnologia s’apliqui per millorar el benestar de les persones de manera segura, justa i respectant les nostres normes socials i culturals:

L’objectiu general de l‘Observatori d’Ètica en Intel·ligència Artificial de Catalunya (OEIAC) és estudiar en detall les conseqüències ètiques i legals i els riscos i oportunitats de la implantació de la Intel·ligència Artificial (AI) en la nostra vida diària des d’un punt de vista transversal, tot vetllant perquè la tecnologia s’apliqui per millorar el benestar de les persones de manera segura, justa i respectant les nostres normes socials i culturals:

-

Determinar les mètriques que permetin analitzar l’evolució del desenvolupament de la Intel·ligència Artificial (AI).

-

Promoure que el desenvolupament de les solucions tecnològiques estigui basat en una Intel·ligència Artificial (AI) ètica, robusta i fiable.

-

Vetllar perquè la tecnologia s’apliqui per millorar el benestar de les persones de manera segura, justa i respectant les nostres normes socials i culturals.

-

Estudiar les conseqüències ètiques i legals i els riscos de la implantació de la Intel·ligència Artificial (AI), en tots els aspectes socials, econòmics, i culturals, i des d’un punt de vista transversal.

-

Generar bones pràctiques en relació a la introducció de la Intel·ligència Artificial (AI), assegurant transparència i vigilància i un ús adequat de les dades que preservi la integritat i el benestar de les persones, de manera que es faciliti la introducció de la IA en les empreses i les administracions.

-

Assegurar un treball en xarxa, és a dir de manera coordinada amb les institucions de país que tenen algun paper en el desenvolupament i ús de la intel·ligència artificial.

2.5.2. ÈTICA I TECNOLOGIA. ALGUNS PROBLEMES ACTUALS

En este trabajo sobre «Ética y Tecnología. Algunos problemas actuales» se analiza la relación de la ética y la tecnología utilizando un enfoque deductivo.

Asimismo, a partir de una rápida visión de algunos aspectos de la situación de la civilización posmoderna y de su percepción de la tecnología, se analiza la relación entre la tecnología y la valoración ética del mundo, de esta forma, se propone una apreciación ética positiva de la tecnología.

Finalmente, se revisan algunos de los principales problemas que el desarrollo tecnológico plantea hoy a la ética, como:

Finalmente, se revisan algunos de los principales problemas que el desarrollo tecnológico plantea hoy a la ética, como:

-

La manipulación genética,

-

La conservación del medio ambiente y

-

La pobreza extrema.

El propósito de este trabajo es contribuir, desde el punto de vista de un tecnólogo, al análisis de un tema que hoy, más que nunca, debe formar parte del acervo cultural de los ingenieros. El autor reconoce las dificultades de un estudio interdisciplinario como el que aquí se aborda, y no se propone obtener conclusiones o recomendaciones, solamente propiciar la reflexión sobre la relación entre ética y tecnología, así como algunos de sus problemas actuales.

La tecnologia tiene implicaciones éticas. Tenemos que dejar de mirar hacia otro lado y ver más allá del pesimismo o del optimismo. Cinco principios incuestionables a tener en cuenta:

La tecnologia tiene implicaciones éticas. Tenemos que dejar de mirar hacia otro lado y ver más allá del pesimismo o del optimismo. Cinco principios incuestionables a tener en cuenta:

-

Respeto a los derechos humanos

-

Priorizar el bienestar

-

Definir la responsabilidad

-

Transparencia

-

Abuso y mal uso de la tecnología

2.6. CASCADA O SALLENT DE TEMES RELACIONATS ENTRE

L’ÈTICA I LA INTELIGÈNCIA ARTIFICIAL

La inteligencia ética:

-

Une proyecto y motivación,

-

Induce a concretar valores,

-

Señala la salud de una cultura.

-

Ofrece libertad y comprensión de la mano en los comportamientos inteligentes.

Para la búsqueda de temas al respecto –Ética e Intel·ligència Artificial (AI)-, cabe pulsar aquí mismo el buscador Google y aparecerá una cascada de enunciados temàticos, entre los cuales se han escogido algunos para la finalidad u objetivo que atañe al articulo del web en cuestión.

Globalmente se acepta que las inteligencias artificiales no tienen un estatus moral-ético.

Es posible modificar programas libremente sin que estos se percaten de lo que está haciendo, por lo que los dilemas morales u éticos no son ejercidos sobre el algoritmo sino sobre las personas que programan o utiliza el sistema.

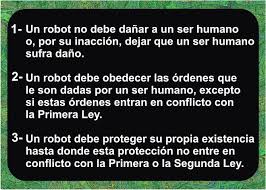

La Ética en la Intel·ligència Artificial (AI) es una rama de la ética dirigida a la existencia de robots inteligentes o cualquier otro ente que posea Intel·ligència Artificial (AI). La posibilidad de crear máquinas pensantes plantea una serie de cuestiones éticas que abarcan diferentes puntos, tanto que las máquinas no lastimen a seres humanos o seres vivos en general, como el estatus moral propio de la máquina.

Por lo general esta dividido en roboética, la preocupación por el comportamiento moral de los seres humanos a medida que diseñan, construyen, usan y tratan a seres de inteligencia artificial, y la ética de las máquinas, que es la preocupación por el comportamiento moral de los agentes morales artificiales (en inglés AMAs). Los pensadores en la actualidad están preocupados por el desarrollo de conciencia en la Intel·ligència Artificial (AI), aunque no necesariamente están enfocados a lo importante, debemos entender que desarrollar conciencia en robots no es lo mismo que darles las funciones para realizar acciones contraproducentes.

Por lo general esta dividido en roboética, la preocupación por el comportamiento moral de los seres humanos a medida que diseñan, construyen, usan y tratan a seres de inteligencia artificial, y la ética de las máquinas, que es la preocupación por el comportamiento moral de los agentes morales artificiales (en inglés AMAs). Los pensadores en la actualidad están preocupados por el desarrollo de conciencia en la Intel·ligència Artificial (AI), aunque no necesariamente están enfocados a lo importante, debemos entender que desarrollar conciencia en robots no es lo mismo que darles las funciones para realizar acciones contraproducentes.

La parte delicada es de qué forma se va a incluir la Ética en la Intel·ligència Artificial (AI).Tomemos de ejemplo un robot programado para producir a toda costa clips de papel, lo que podría llevarlo a buscar el control del mundo para obtener los recursos para cumplir su meta: en realidad el robot no es malvado, solamente que su sistema no está programado para funcionar con éticas complejas o simplemente básicas por lo que lleva al último fin su función

La parte delicada es de qué forma se va a incluir la Ética en la Intel·ligència Artificial (AI).Tomemos de ejemplo un robot programado para producir a toda costa clips de papel, lo que podría llevarlo a buscar el control del mundo para obtener los recursos para cumplir su meta: en realidad el robot no es malvado, solamente que su sistema no está programado para funcionar con éticas complejas o simplemente básicas por lo que lleva al último fin su función

-

1. La Inteligencia artificial específica de dominio con la realización de algoritmos

-

2. La Inteligencia artificial general

-

3. La Ética del robot

-

4. Sesgos en los sistemas de la Inteligencia artificial (IA)

-

5. Los derechos de robot

-

6. La Ética de la máquina

-

7. Consecuencias no deseadas del siglo XXI en la utilización de la Inteligencia artificial

-

8. Algunas amenaza a la dignidad humana en el uso de la Inteligencia artificial

-

9. Transparencia y código abierto en el desarrollo de la Inteligencia artificial

-

10. Estatus moral-ético de las inteligencias artificiales

-

11. La inteligencia artificial aplicadas a las Armas

-

12. Organizaciones para la práctica tecnológica de la Inteligencia artificial

-

13. La Inteligencia artificial en la ficción

-

14. La Inteligencia artificial en la Literatura

I, tot fent un recorregut per entre les entranyes del buscador Google, es poden escatir tot una sèrie de temes de prou interès que abasten -en aquest cas- tot allò relacionat amb la Intel·ligència Artificial (AI):

-

Les seves possibilitats extremes,

-

Els perills que pot comportar el desenvolupament de la intel·ligència artificial i

-

Les personalitats que més han excel·lit en aquest camp

Atesa la progressió geomètrica o infinitessimal en referència a la velocitat d’innovació contemporània, tot el que actualment es dona per fet i com tancat, el futur del demà ja ho supera mitjançant un capgirell novedós i revolucionari, avui impensable:

2.6.1. ¿CÓMO SE RELACIONA LA ÉTICA Y LA INTELIGENCIA ARTIFICIAL…?

2.6.1. ¿CÓMO SE RELACIONA LA ÉTICA Y LA INTELIGENCIA ARTIFICIAL…?

Es posible modificar programas libremente sin que estos se percaten de lo que está haciendo, por lo que los dilemas morales no son ejercidos sobre el algoritmo sino sobre la gente que utiliza el sistema.

La inteligencia ética:

- Une proyecto y motivación,

- Induce a concretar valores,

- Señala la salud de una cultura.

Libertad y comprensión van de la mano en los comportamientos inteligentes.

2.6.2. ¿CÓMO SEDEBE APLICAR LA ÉTICA EN LA INTELIGENCIA ARTIFICIAL…?

2.6.2. ¿CÓMO SEDEBE APLICAR LA ÉTICA EN LA INTELIGENCIA ARTIFICIAL…?

El primer paso es llegar a un acuerdo sobre los valores que deben consagrarse y las reglas deben aplicarse.

Existen muchos marcos y directrices, pero se aplican de forma desigual y ninguno es verdaderamente global. La IA es global, por lo que necesitamos un instrumento global que la regule.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Ética de la Inteligencia Artificial – Unesco.orgunesco.org

- ¿Cómo se debe aplicar la ética en la Inteligencia Artificial…?

2.6.3. ¿QUÉ SON LOS LÍMITES ÉTICOS DE LA INTELIGENCIA ARTIFICIAL…?

2.6.3. ¿QUÉ SON LOS LÍMITES ÉTICOS DE LA INTELIGENCIA ARTIFICIAL…?

Los límites de la ética en la inteligencia artificial se relacionan estrictamente con su autonomía.

Aunque se entiende que la IA es capaz de realizar procesos por sí mismos, «autónomamente», la verdad es que el sentido estricto de autonomía aún no se alcanza.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Ética en la inteligencia artificial | Fundamentos clavesfuturoelectrico.com

- ¿Qué son los limites éticos de la inteligencia artificial…?

2.6.4. ¿QUIÉN ES EL RESPONSABLE DE LA ÉTICA DE LA INTELIGENCIA ARTIFICIALuién…?

2.6.4. ¿QUIÉN ES EL RESPONSABLE DE LA ÉTICA DE LA INTELIGENCIA ARTIFICIALuién…?

El mencionado informe de IBM establece que las empresas que han adoptado soluciones avanzadas de IA lideran la ética en este ámbito.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Inteligencia artificial: Quién es el responsable de la ética | Sage Advicesage.com

- ¿Quién es el responsable de la ética de la IA…?

2.6.5. ¿QUÉ ES UN DESAFÍO ÉTICO MORAL PARA LA INTELIGENCIA ARTIFICIAL…?

2.6.5. ¿QUÉ ES UN DESAFÍO ÉTICO MORAL PARA LA INTELIGENCIA ARTIFICIAL…?

Se trata de datos que reflejan la desconfianza de la población ante la opacidad y falta de transparencia que en múltiples ocasiones envuelve a los sistemas de inteligencia artificial con los que a menudo interactúan los usuarios.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Los desafíos éticos de la inteligencia artificial – Reason Whyreasonwhy.es

- ¿Qué es un desafío ético moral para la inteligencia artificial IA…?

2.6.6. ¿QUÉ PROBLEMAS IMPLICA LA TECNOLOGÍA EN LA ÉTICA..?

2.6.6. ¿QUÉ PROBLEMAS IMPLICA LA TECNOLOGÍA EN LA ÉTICA..?

¿Cuáles son los problemas especiales a que se enfrenta hoy la ética de la tecnología? En general, se confrontan a nivel global tres problemas muy importantes:

- El medio ambiente,

- La manipulación genética y

- La desigualdad social.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Ética y tecnología. Algunos problemas actuales – https://www.revistaingenieria.unam.mx › numeros

- ¿Qué problemas implica la tecnología en la ética…?

2.6.7. ¿QUÉ ES UN DESfAFÍO ÉTICO-MORAL PARA LA INTELIGENCIA ARTIFICIAL…?

2.6.7. ¿QUÉ ES UN DESfAFÍO ÉTICO-MORAL PARA LA INTELIGENCIA ARTIFICIAL…?

Se trata de datos que reflejan la desconfianza de la población ante la opacidad y falta de transparencia que en múltiples ocasiones envuelve a los sistemas de inteligencia artificial con los que a menudo interactúan los usuarios.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Los desafíos éticos de la inteligencia artificial – Reason Whyreasonwhy.es

- ¿Qué es un desafío ético moral para la inteligencia artificial IA…?

2.6.8. ¿CÓMO SE APLICA LA ÉTICA EN LA INFORMÁTICA…?

2.6.8. ¿CÓMO SE APLICA LA ÉTICA EN LA INFORMÁTICA…?

Los mandamientos son los siguientes:

- No usarás una computadora para dañar a otras personas.

- No interferirás con el trabajo de la computadora de otras personas.

- No curiosearás en los archivos informáticos de otras personas.

- No usarás una computadora para robar.

- No usarás una computadora para dar falso testimonio.

2.6.9. ¿QUIÉN ES EL RESPONSABLE DE LA ÉTICA DE LA INTELIGENCIA ARTIFICIAL…?

2.6.9. ¿QUIÉN ES EL RESPONSABLE DE LA ÉTICA DE LA INTELIGENCIA ARTIFICIAL…?

El mencionado informe de IBM establece que las empresas que han adoptado soluciones avanzadas de IA lideran la ética en este ámbito.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Inteligencia artificial: Quién es el responsable de la ética | Sage Advicesage.com

- ¿Quién es el responsable de la ética de la IA…?

2.6.10. ¿QUÉ DILEMAS ÉTICOS ENFRENTA LA INTELIGENCIA ARTIFICIAL…?

2.6.10. ¿QUÉ DILEMAS ÉTICOS ENFRENTA LA INTELIGENCIA ARTIFICIAL…?

Hay muchos desafíos éticos:

- La falta de transparencia de las herramientas de la IA

- Las decisiones de la IA no siempre son inteligibles para los humanos.

- La IA no es neutral

- Las decisiones basadas en la IA son susceptibles de inexactitudes, resultados discriminatorios, sesgos incrustados o insertados.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Inteligencia artificial: ejemplos de dilemas éticos – UNESCOunesco.org

- ¿Qué dilemas eticos enfrenta la IA…?

2.6.11. ¿CÓMO DEBE APLICARSE LA ÉTICA EN LA INTELIGENCIA ARTIFICIAL…?

2.6.11. ¿CÓMO DEBE APLICARSE LA ÉTICA EN LA INTELIGENCIA ARTIFICIAL…?

El primer paso es llegar a un acuerdo sobre los valores que deben consagrarse y las reglas deben aplicarse.

Existen muchos marcos y directrices, pero se aplican de forma desigual y ninguno es verdaderamente global. La IA es global, por lo que necesitamos un instrumento global que la regule.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Ética de la Inteligencia Artificial – Unesco.orgunesco.org

- ¿Cómo se debe aplicar la ética en la IA…?

2.6.12. ¿QUÉ CRÍTICAS SE LE PUEDEN HACER A LA INTELIGENCIA ARTIFICIAL…?

2.6.12. ¿QUÉ CRÍTICAS SE LE PUEDEN HACER A LA INTELIGENCIA ARTIFICIAL…?

La inteligencia artificial perjudica a las poblaciones marginadas al aumentar los obstáculos que deben afrontar para acceder a derechos sociales. Es decir, se utilizan para mantener fuera o expulsar a las personas del sistema de bienestar, así como del acceso a las demandas y derechos de asilo.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

2.6.13. ¿CÓMO AFECTA LA INTELIGENCIA ARTIFICIAL EN LA SOCIEDAD…?

2.6.13. ¿CÓMO AFECTA LA INTELIGENCIA ARTIFICIAL EN LA SOCIEDAD…?

La inteligencia artificial puede ser el catalizador de nuevos cambios, profundos y positivos, en el empleo y las relaciones laborales, en la desubicación de los centros de trabajo y, en general, en una mejora de las condiciones de vida.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- El impacto de la Inteligencia Artificial en nuestra sociedad – Retos y …csic.es

- La Ética en la Inteligencia artificial

- ¿Cómo afecta la IA en la sociedad…?

2.6.14. ¿CÓMO AFECTA LA INTELIGENCIA ARTIFICIAL EN LA VIDA COTIDIANA…?

2.6.14. ¿CÓMO AFECTA LA INTELIGENCIA ARTIFICIAL EN LA VIDA COTIDIANA…?

Utilizamos la IA para resolver problemas de nuestra vida cotidiana:

- Para encontrar el camino más rápido entre nuestra casa y el lugar de trabajo,

- Para leer páginas web escritas en otro idioma,

- Para buscar información y un sinfín de otros propósitos.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Diez efectos de la inteligencia artificial en nuestra vida cotidiana | liberties.eu • liberties.eu

- ¿Cómo afecta la IA en la vida cotidiana…?

2.6.15. ¿QUÉ PRINCIPIOS ÉTICOS DEBEN REGIR PARA LOS ROBOTS CON LA INTELIGENCIA ARTIFICIAL…?

2.6.15. ¿QUÉ PRINCIPIOS ÉTICOS DEBEN REGIR PARA LOS ROBOTS CON LA INTELIGENCIA ARTIFICIAL…?

La resolución de la Eurocámara recoge principios básicos como:

- La protección de la dignidad humana,

- La privacidad,

- La libertad o

- La igualdad de acceso

Proteger, en definitiva, a los humanos del daño causado por robots: la dignidad humana. Respetar el rechazo a ser cuidado por un robot. Proteger la libertad humana frente a los robots.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Roboética: leyes de la robótica y ética para robots – Bloygo – Yoigo • yoigo.com

- ¿Qué principios éticos deben de regir a los robots con IA…?

2.6.16. ¿QUÉ SE ENTIENDE O ES UN DESAFÍO ÉTICO-MORAL PARA LA INTELIGENCIA ARTIFICIAL..?

2.6.16. ¿QUÉ SE ENTIENDE O ES UN DESAFÍO ÉTICO-MORAL PARA LA INTELIGENCIA ARTIFICIAL..?

Se trata de datos que reflejan la desconfianza de la población ante la opacidad y falta de transparencia que en múltiples ocasiones envuelve a los sistemas de inteligencia artificial con los que a menudo interactúan los usuarios.

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Los desafíos éticos de la inteligencia artificial – Reason Why • reasonwhy

- ¿Qué es un desafío ético moral para la inteligencia artificial (IA)…?

2.6.17. ¿QUÉ DICE LA FILOSOFÍA SOBRE LA INTELIGENCIA ARTIFICIAL…?

2.6.17. ¿QUÉ DICE LA FILOSOFÍA SOBRE LA INTELIGENCIA ARTIFICIAL…?

La filosofía de la inteligencia artificial intenta responder a las siguientes preguntas:

- ¿Puede una máquina actuar inteligentemente…?

- ¿Puede resolver cualquier problema que una persona resolvería pensando…?

- ¿Son la inteligencia humana y la inteligencia de la máquina lo mismo…?

Buscar la respuesta del contenido de la pregunta-cuestión, pulsando el link o enunciado de color azul:

- Filosofía de la inteligencia artificial. | HiSoUR Arte Cultura Historia • hisour.com